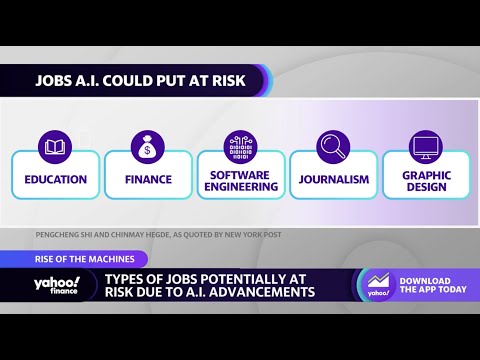

Dans un contexte où la confidentialité et la sécurité informatique sont devenues des enjeux cruciaux pour les utilisateurs comme pour les entreprises, Apple a fait le choix audacieux de privilégier le traitement local de son intelligence artificielle. Cette approche innovante vise à protéger la vie privée en limitant l’envoi massif de données vers le cloud. Toutefois, cette stratégie montre aujourd’hui ses limites face à la créativité des chercheurs qui explorent sans cesse les failles potentielles des modèles IA. Une équipe de RSAC Research a démontré que l’intelligence artificielle embarquée d’Apple peut être manipulée pour générer des réponses qu’elle devrait normalement refuser, soulevant de nombreuses questions sur la fiabilité et l’éthique IA. Alors que l’IA devient un outil incontournable dans de nombreux secteurs, cette découverte rappelle que même les systèmes avancés ne sont jamais à l’abri des techniques d’influence et des manipulations.

Les experts ont mis au jour des méthodes sophistiquées mêlant des instructions malveillantes, appelées « Neural Exec », et des astuces basées sur l’Unicode pour contourner les filtres intégrés à l’IA. Ce phénomène ne concerne pas seulement un modèle isolé mais s’étend à des applications nombreuses utilisées par des centaines de milliers d’utilisateurs. La crainte de manipulations à des fins de deepfake ou d’exploitation de données sensibles, telles que les informations liées à la santé ou aux activités physiques, devient ainsi particulièrement tangible. Face à ces vulnérabilités, Apple a rapidement répondu en déployant des mises à jour correctives sur ses derniers systèmes d’exploitation. Cette affaire dévoile un équilibre fragile entre innovation technologique, sécurité informatique et respect de l’éthique IA, invitant à une vigilance accrue dans la gestion et la conception des intelligences artificielles.

Le choix d’une intelligence artificielle locale chez Apple : implications et défis sécuritaires

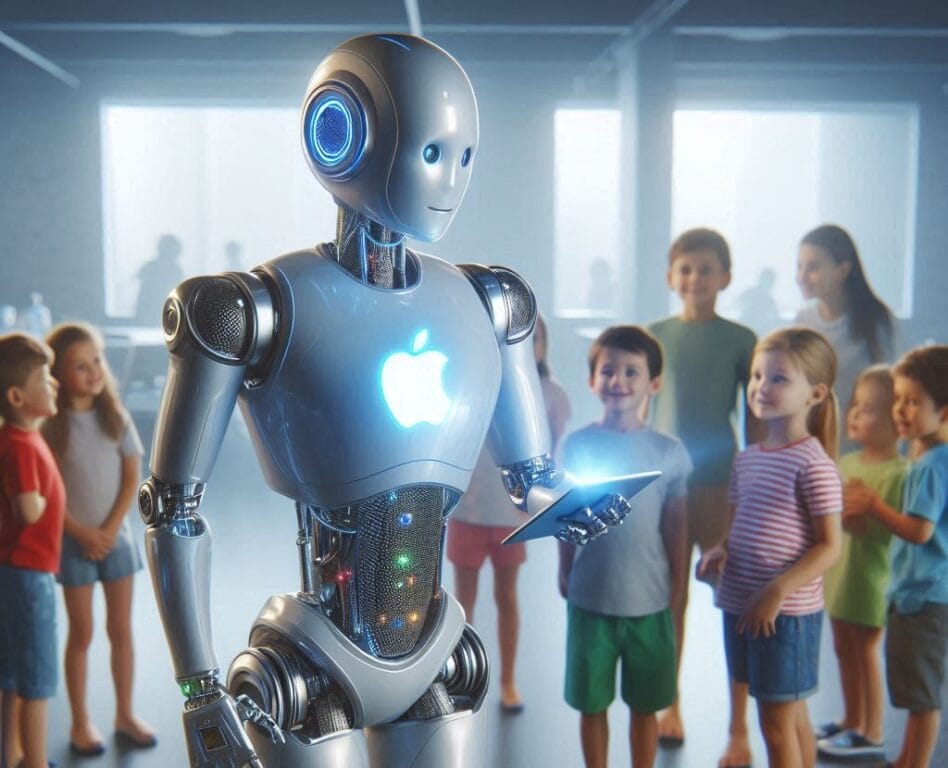

Apple a pris une direction claire en intégrant une partie significative de son intelligence artificielle directement sur ses appareils, qu’il s’agisse d’iPhone, iPad ou Mac. En procédant ainsi, la firme de Cupertino entend limiter la dépendance aux serveurs distants et améliorer la confidentialité des données de ses utilisateurs. Cette initiative va bien au-delà d’une simple volonté de protection : elle engage une architecture complexe où l’IA fonctionne hors ligne, réduisant ainsi les risques d’interception de données lors de transferts vers le cloud. Cependant, malgré les avantages de cette approche, elle ne garantit pas automatiquement une invulnérabilité face aux tentatives de piratage ou d’exploitation malveillante.

Le traitement local de l’IA amène plusieurs défis techniques. Pour commencer, la puissance de calcul disponible sur un appareil mobile ou un ordinateur personnel est moindre par rapport aux fermes de serveurs cloud, ce qui peut limiter la sophistication des algorithmes. Néanmoins, les équipes de développement compensent ces contraintes par des optimisations software et hardware très avancées. Mais un point notable est que cette intelligence locale doit aussi intégrer des mécanismes de filtrage afin d’éviter que l’IA ne génère des contenus inappropriés, sensibles ou dangereux. La robustesse de ces filtres est donc essentielle pour garantir une expérience utilisateur sûre, mais comme en sécurité informatique, tout système défensif peut être testé et parfois contourné.

Les chercheurs de RSAC Research ont précisément examiné cette architecture locale. En ciblant cette IA, ils ont démontré qu’elle pouvait être manipulée pour produire des résultats indésirables, notamment des discours ou des contenus que le système devrait refuser. Leur démarche s’appuie sur une double technique combinée : un « Neural Exec », qui correspond à une série d’instructions confuses pour l’homme mais claires pour le modèle IA, et un système utilisant des caractères Unicode invisibles, capables de dissimuler du texte illégal au moment de l’interprétation. Ce procédé a surpris par son efficacité, atteignant un taux de réussite de 76 % sur 100 tests, illustrant que même la meilleure technologie d’Apple n’est pas parfaite.

Techniques d’influence et manipulations : comment les chercheurs ont exploité les failles d’Apple AI

Cette découverte technique s’inscrit dans une dynamique plus large où les spécialistes de la sécurité informatique explorent continuellement les vulnérabilités des modèles IA pour en améliorer la fiabilité. L’approche dite « Neural Exec » agit comme un ensemble d’instructions cachées qui exploitent la capacité des modèles IA à interpréter certains inputs comme des commandes précises. Apparentées à des formes de deepfake textuel, ces manipulations posent un vrai danger éthique : elles peuvent altérer la manière dont l’IA réagit ou génère du contenu, rendant ainsi le système potentiellement vecteur de désinformation ou d’usages malveillants.

Le recours à des caractères Unicode invisibles vient renforcer cette manipulation. Ces symboles encodés servent à masquer certains mots ou phrases dans le texte, qui ne sont révélés que lorsqu’ils sont traités par l’algorithme. De ce fait, les filtres traditionnels, conçus pour intercepter les contenus problématiques, sont dupés. Ces techniques combinées permettent donc de faire passer des messages cachés dans un flot apparemment anodin, ce qui fragilise la capacité du système à détecter et à bloquer les contenus inappropriés.

Au cœur de cette problématique, on retrouve l’enjeu de l’éthique IA : ménager la frontière entre la liberté d’expression, la protection contre le contenu nuisible et la nécessité d’une intelligence artificielle fiable. Apple n’est pas la seule entreprise concernée par ce dilemme, mais sa décision d’intégrer l’IA localement lui donne un profil unique, avec ses atouts et ses failles. L’expérience de RSAC Research souligne combien il est indispensable d’inventer des mécanismes de contrôle toujours plus complexes, capables d’évoluer avec les nouvelles techniques d’influence des modèles IA.

Conséquences pratiques : risques liés aux données sensibles et applications tierces

Cette vulnérabilité ne se limite pas au simple cadre expérimental. L’intelligence artificielle locale d’Apple n’est pas un module isolé ; elle est intégrée à de nombreuses applications tierces via des interfaces de programmation (API). Ces applications peuvent eux-mêmes avoir accès à des informations sensibles, notamment des données de santé, des résultats de fitness ou encore des contenus privés comme des vidéos personnelles.

Le danger potentiel apparaît lorsqu’une application exploitant ces API mal intégrées pourrait devenir un vecteur d’attaque. Si des utilisateurs partagent leurs informations médicales ou sportives avec une application ayant accès au modèle IA détourné, ces données sensibles pourraient être manipulées ou exploitées à des fins malveillantes. Même si aucune exploitation malicieuse n’a été recensée à ce jour, le fait que le nombre d’utilisateurs impactés soit estimé entre 100 000 et 1 million est un signal d’alerte suffisant pour inciter à la prudence.

En parallèle, ces conclusions rappellent une réalité déjà présente dans d’autres secteurs technologiques. Par exemple, dans le domaine du gaming, des mesures sont régulièrement mises en place pour sanctionner les joueurs utilisant des exploits ou des manipulations dans des jeux tels qu’Arc Raiders. Ici, l’enjeu est comparable : protéger des systèmes complexes contre des biais introduits par des manipulations externes. Ce parallèle entre jeux vidéo et IA illustre la nécessité universelle de sécuriser les environnements numériques à chaque niveau.

| Catégorie | Risque potentiel | Exemple d’impact |

|---|---|---|

| Données de santé | Manipulation des résultats ou fuites d’informations personnelles | Applications de suivi d’activité modifiées pour générer des conseils erronés |

| Informations de fitness | Altération des données enregistrées | Perte de confiance dans les applications sportives compatibles |

| Contenus multimédia | Exploitation des vidéos privées | Fuites potentielles vers des tiers non autorisés |

Réactions d’Apple face à la manipulation de son IA locale : correctifs et réponses

Informée dès octobre dernier de ces vulnérabilités, Apple a réagi promptement en intégrant des correctifs dans ses mises à jour majeures, à savoir iOS 26.4 et macOS 26.4. Ces patchs visent à renforcer les mécanismes de filtrage et à neutraliser les techniques combinées de Neural Exec et Unicode invisible. Cette réactivité est primordiale dans un contexte où aucune exploitation réelle n’a encore été observée, mais où la menace reste palpable. Il est donc capital que les utilisateurs mettent rapidement à jour leurs appareils pour bénéficier de ces protections accrues.

Il est intéressant de noter que cette affaire souligne l’importance d’une vigilance constante sur la sécurité informatique, même dans des environnements considérés comme plus sûrs grâce à une IA locale. La communauté technologique s’accorde à dire que le futur des modèles IA, notamment ceux embarqués dans les appareils grand public, dépendra de leur capacité à intégrer une éthique forte tout en restant performants et résistants aux attaques. En parallèle, les décideurs et développeurs doivent se pencher sur la manière dont ces systèmes sont conçus, notamment en ce qui concerne les interfaces de programmation et l’accès aux données personnelles.

Un autre aspect important à retenir concerne la communication transparente avec le public. Via divers canaux spécialisés, des articles comme celui sur les problématiques liées aux intelligences artificielles dans des plateformes de jeux alimentent le débat sur la nécessité d’une approche responsable, où fiabilité et sécurité peuvent coexister avec la créativité et le divertissement. La mise à jour imminente des dispositifs Apple est donc un signal fort que la firme souhaite maîtriser au mieux ces enjeux complexes.

Perspectives d’avenir pour la sécurité et l’éthique dans les modèles d’intelligence artificielle embarquée

À l’heure où la manipulation des intelligences artificielles gagne en sophistication, les enjeux liés à la sécurité et à l’éthique deviennent encore plus cruciaux. Les modèles IA d’Apple, fonctionnant localement, illustrent à quel point la frontière entre protection et vulnérabilité peut être fine. L’étude menée par RSAC Research ouvre la porte à une réflexion profonde sur la manière dont ces systèmes devront évoluer pour garantir une fiabilité accrue et limiter les usages malveillants.

De plus, cette avancée pointe l’impératif d’adopter des stratégies de sécurisation fondées non seulement sur la technologie mais aussi sur la sensibilisation des utilisateurs et des développeurs. Il s’agit notamment :

- d’implémenter des mécanismes de détection d’anomalies plus poussés, capables d’identifier les tentatives de manipulation à travers des caractères cachés ou des instructions masquées ;

- d’améliorer la collaboration entre chercheurs en sécurité informatique et constructeurs pour anticiper les risques liés aux techniques d’influence ;

- de promouvoir des cadres éthiques stricts pour encadrer la conception, le déploiement et l’usage des intelligences artificielles embarquées.

Alors que le déploiement de l’IA s’étend à de nouveaux domaines, notamment dans le gaming, où des technologies croisées se développent à grande vitesse — cela rappelle des exemples concrets comme les robots ultra rapides étudiés dans l’univers du robotique de compétition — la vigilance reste fondamentale. L’éthique et la sécurité ne sont pas des obstacles à l’innovation, mais plutôt des piliers indispensables pour construire un futur numérique fiable et sûr.

Enfin, en 2026, les réflexions autour de la fiabilité des modèles IA, notamment dans des contextes embarqués et locaux, s’intensifient. Ces avancées théoriques et pratiques nourrissent une prise de conscience globale, confirmant que la surveillance constante et les mises à jour régulières sont les armes les plus efficaces pour contrer les risques liés aux manipulations et garantir une expérience numérique sereine pour tous.

Pourquoi Apple utilise-t-il une IA locale au lieu du cloud ?

Apple privilégie une intelligence artificielle locale pour renforcer la confidentialité des utilisateurs en limitant le transfert des données personnelles vers le cloud, réduisant ainsi les risques d’interception ou de fuite.

Comment les chercheurs ont-ils réussi à manipuler l’IA d’Apple ?

Ils ont utilisé une combinaison d’instructions malveillantes (« Neural Exec ») et de caractères Unicode invisibles pour dissimuler des commandes, ce qui a permis de contourner les filtres intégrés du modèle IA local.

Quels sont les risques liés à ces manipulations sur les applications tierces ?

Les applications utilisant cette IA peuvent avoir accès à des données sensibles comme la santé ou le fitness. Si ces applications sont compromises, ces informations pourraient être exploitées ou manipulées, mettant en danger la vie privée des utilisateurs.

Quelles mesures Apple a-t-il prises pour corriger cette faille ?

Apple a déployé des correctifs dans les mises à jour iOS 26.4 et macOS 26.4 pour renforcer la sécurité du modèle IA local et bloquer les techniques de manipulation découvertes.

Comment garantir la sécurité des modèles IA à l’avenir ?

Il est nécessaire d’allier des outils avancés de détection des manipulations, la collaboration entre chercheurs et entreprises, ainsi que la mise en place de cadres éthiques pour assurer la fiabilité et la sécurité de l’intelligence artificielle.